گاهی اوقات فناوریهای جدید و کاربردی برای اهداف مجرمانه استفاده میشوند و هوش مصنوعی نیز از این قاعده مستثنا نیست. دیپ فیک (Deepfake) یکی از فعالیتهای مخربی محسوب میشود که هوش مصنوعی در سالهای اخیر برای انجام آن مورد سوءاستفاده قرار گرفته است.

جی پلاس؛ دیپ فیک یکی از فناوریهای جنجالی ایجاد شده بر پایه هوش مصنوعی برای ساخت عکس و فیلم جعلی و ساختگی است که هم میتواند تهدیدی بزرگ برای جامعه باشد و برای اهداف مجرمانه و غیراخلاقی استفاده شود و هم برای ساخت محتواهای مفید و کاربردی به کار گرفته شود. در این مطلب میخواهیم شما را بطور کامل با این فناوری آشنا کنیم.

هوش مصنوعی در دهههای اخیر پیشرفت قابلتوجه و سریعی داشته و در حوزههای مختلف استفاده شده است. این فناوری انقلابی کیفیت و راندمان بسیاری از صنایع را به میزان زیادی افزایش داده؛ البته این ابزار از آغاز پیدایش خود تاکنون همیشه هم برای اهداف مثبت و سازنده استفاده نشده است.

گاهی اوقات فناوریهای جدید و کاربردی برای اهداف مجرمانه استفاده میشوند و هوش مصنوعی نیز از این قاعده مستثنا نیست. دیپ فیک (Deepfake) یکی از فعالیتهای مخربی محسوب میشود که هوش مصنوعی در سالهای اخیر برای انجام آن مورد سوءاستفاده قرار گرفته است.

نرمافزارها و اپلیکیشنهای طراحیشده برای دیپ فیک که بر پایه هوش مصنوعی ایجاد شدهاند، برای جایگزین کردن چهره یک فرد با چهره فرد دیگری آموزش داده شدهاند. قربانیان این کار غیراخلاقی در اغلب موارد سلبریتیها و سیاستمداران هستند.

در این مطلب شما را با دیپ فیک، نحوه عملکردش، کاربردها و خطراتش، نحوه تشخیص این محتواها و همچنین آیندهاش آشنا میکنیم.

واژه DeepFake از دو کلمه Deep به معنای عمیق و Fake معنای جعلی و ساختگی تشکیل شده است. کلمه Deep که با فناوری هوش مصنوعی ارتباط دارد، به یادگیری عمیق اشاره میکند. فناوری دیپ فیک برای جایگزین کردن یا ایجاد صورتهای مختلف با جزئیات کامل، صحبتها و حالتهای عاطفی چهره به کار میرود.

در حقیقت این فناوری به منظور تقلید دیجیتالی کارهای در حال انجام توسط شخص خاصی است که آن شخص اصلاً آن کارها را انجام نداده و آن کارها و حرکات ساختگی و شبیهسازیشده هستند.

تاریخچه دیپ فیک

این فناوری توسط یک فرد خاص ایجاد نشده است و نخستین مراحل دیپ فیک برای نخستین بار در دهه ۱۹۹۰ توسط مؤسسات آموزشی و پس از آن توسط گروه بیشتری از افراد انجام شد. اگرچه نرمافزارها و اپلیکیشنهای مورد استفاده برای محتوای دیپ فیک نرمافزارهای فراگیری نیستند؛ اما اخبار و اطلاعات مرتبط با ساخت چنین نرمافزارهایی در رسانههای اجتماعی سروصدای زیادی به پا کرده است.

یکی از نخستین موارد سوءاستفاده از دیپ فیک در انگلستان رخ داد. در جریان این سوءاستفاده که در حقیقت یک کلاهبرداری بوده است، مدیرعامل یک شرکت انگلیسی فعال در حوزه انرژی با جعل صدای یکی از روسای آلمانی این شرکت فریب خورد و به ۲۲۰ هزار یورو به یک حساب بانکی شخص ثالث واریز کرد.

دیپ فیک چگونه کار می کند؟

چندین تکنیک برای ساخت نرمافزارها و اپلیکیشنهای دیپ فیک با استفاده از الگوریتمهای یادگیری ماشینی وجود دارد. به بیان ساده در این نرمافزارها چند الگوریتم با قابلیت ساخت محتوا بر اساس دادههای ورودی ایجاد شده است. چنانچه بخواهیم از نرمافزار برای جایگزینی کامل صورت یک فرد یا بخشی از آن استفاده کنیم، ابتدا باید نحوه انجام این کار را به نرمافزار آموزش دهیم.

در فرایند ساخت نرمافزارهای دیپ فیک ابتدا حجم بسیار گستردهای از اطلاعات در اختیار آنها قرار میگیرد و نرمافزار از این اطلاعات برای ساخت محتوا بر مبنای اطلاعات جدیدی که خودش ایجاد کرده است، استفاده میکند. این اطلاعات عمدتاً بر پایه Autoencoder (شبکههای عصبی مصنوعی خودرمزگذار) و گاهی اوقات هم بر پایه Generative Adversarial Networks یا بهاختصار GAN (شبکه زایای دشمنگونه) ایجاد میشوند. اجازه دهید بیشتر با این دو روش آشنا شویم.

شبکههای عصبی مصنوعی خودرمزگذار در حقیقت مجموعهای از شبکههای عصبی خود نظارتی هستند که اساساً بر پایه کاهش ابعاد عمل میکنند و همچنین یاد میگیرند که داده ایجاد شده توسط خودشان را کپی کنند. این شبکهها داده محور هستند؛ یعنی میتوانند دادهها را مشابه آنچه که برای آن آموزش داده شدهاند، فشردهسازی کنند. علاوه بر این، خروجی شبکه عصبی خودرمزگذار دقیقاً مانند ورودی آن است.

این شبکه از سه قسمت تشکیل شده که شامل یک انکودر (رمزگذار)، یک کد و یک دیکودر (رمزگشا) میشود. انکودر داده ورودی را فشردهسازی میکند و پس از اینکه دیکودر داده فشردهشده را بر اساس کد رمزگشایی کرد، کد ایجاد میشود.

انواع مختلفی از شبکههای عصبی خودرمزگذار وجود دارد که از میان آنها میتوان به شبکههای خودرمزگذار حذف نویز (Convolutional Autoencoders)، شبکه خودرمزگذار عمیق (Deep Autoencoders)، شبکه خودرمزگذار عمیق (Deep Autoencoders) شبکه خودرمزگذار انقباضی (Contractive Autoencoders) و شبکه خودرمزگذار همگشتی یا کانولوشنال (Convolutional Autoencoders) و سایر موارد میشود.

در حقیقت این شبکهها در حین فرایند ساخت تصاویر و ویدیوهای جعلی، برای حذف نویزهای تصویر و فیلمها (دانههای کوچک روی تصویر شبیه به برفک تلویزیون)، به حداقل رساندن خطا در هنگام بازآفرینی تصاویر یا ویدیوها با استفاده از فیلترهای مختلف، فشردهسازی تصاویر و ویدیوها، رمزگذاری دادهها و درنهایت ایجاد تصاویر و فیلمها به کار گرفته میشوند.

شبکه زایای دشمنگونه

شبکههای زایای دشمنگونه برای ایجاد مدل از مجموعه دادههای ورودی استفاده میشوند. این شبکهها اطلاعاتی را از دادههای ورودی فرامیگیرند که از آنها برای ایجاد دادههای جدید استفاده میکنند. این شبکه که در واقع یک سیستم محسوب میشود، توسط دو شبکه عصبی مجزا آموزش میبیند که شامل یک ایجادکننده (Generator) و یک تشخیصدهنده (Discriminator) میشود.

ایجادکننده قوانین و الگوهای موجود در مجموعه دادههای ورودی را استخراج میکند و برای بازآفرینی آنها آموزش میبیند. داده ایجاد شده توسط ایجادکننده همراه با داده واقعی برای تشخیصدهنده جهت ارزیابی ارسال میشود. در واقع هدف ایجادکننده فریب الگوریتم تشخیصدهنده است.

در فرایند ایجاد محتوای ساختگی با این روش باید آموزش تا جایی ادامه پیدا کند که الگوریتم تشخیصدهنده دیگر نتواند داده ساختگی را از داده واقعی تشخیص دهد. افزایش دشواری تشخیص داده ساختگی از داده واقعی به معنای بهتر شدن سطح آموزش سیستم است البته در کل استفاده از شبکه زایای دشمنگونه در مقایسه با شبکه عصبی مصنوعی رمزنگار برای ساخت محتوای جعلی و ساختگی دشوارتر و نیازمند منابع بیشتری است و اغلب برای ساخت تصاویر استفاده میشود، نه ویدیو.

دیپ فیک تا چه اندازه خطرناک است؟

دیپ فیک یکی از خطرناکترین کاربردهای هوش مصنوعی است و چنین تکنیک مجرمانهای در دنیای واقعی غالباً برای بدنام کردن و کلاهبرداری استفاده میشود.

در برخی از موارد محتوای دیپ فیک از محتوای واقعی قابلتشخیص نیست. این فناوری میتواند برای وارد کردن صدمات بزرگ به شهرت و آبروی افراد و یا ایجاد این تصور که شخص خاصی حرفی را زده یا عملی را انجام داده به کار گرفته شود. در حقیقت میتوان دیپ فیک را به یک اسلحه بسیار خطرناک در دست مجرمان سایبری حرفهای تشبیه کرد که میتواند برای هر هدفی استفاده شود.

دیپ فیک چگونه جامعه ما را تحت تأثیر قرار میدهد؟

استفاده افراد خطرناک با اهداف شوم و مخرب از دیپ فیک میتواند آشوبها و ابهامات زیادی را به دنبال داشته باشد. در سال ۲۰۱۸ ویدیویی ساختگی از دو مرد که کودکی را در هند دزدیده بودند، در واتساپ بارگذاری شد. انتشار گسترده این ویدیو باعث هراس مردم هند شد و چنین اتفاقی را تهدید بزرگی برای خود میدانستند.

افراد تأثیرگذار، رهبران و ستارگان بزرگ در هر جامعهای نقش مهمی دارند و میتوانند افراد زیادی را به طرق مختلف تحت تأثیر قرار دهند؛ بنابراین ارائه اطلاعات نادرست از سوی آنها میتواند نگرش مردم را تغییر دهد و آنها را به انجام کارهای خاصی تشویق کند؛ بنابراین چنین اتفاقی میتواند عواقب غیرقابلپیشبینی و احتمالاً بدی را به دنبال داشته باشد.

از زمان پیدایش این فناوریها، اقدامات مجرمانه نظیر انتشار عکسها و ویدیوهای غیراخلاقی ساختگی از افراد مشهور در اینترنت افزایش یافته است. حتی ممکن است سیاستمداران و مسئولان ارشد یک کشور هم قربانی دیپ فیک شوند و این اتفاق تاکنون برای چند رئیسجمهور آمریکا رخ داده است.

افرادی که قصد تخریب چنین مقاماتی را دارند، میتوانند با ساخت ویدیوهای جعلی دربردارنده اخبار و دستورات ناخوشایند، اعتماد افراد به آنها را از بین ببرند و محبوبیت آنها را کمرنگ کنند.

آیا دیپ فیک غیرقانونی است؟

به دلیل اینکه در حال حاضر تنها چند سال از آغاز پیدایش دیپ فیک میگذرد، هنوز بهصورت قانونی و جدی با کاربردهای غیرقانونی و غیراخلاقی آن مقابله نشده و قانونگذاران خود را درگیر این موضوع نکردهاند؛ حتی در برخی کشورها هم هیچ قانونی برای مقابله با این فناوری وضع نشده است. اما در برخی از کشورها مثل چین قوانینی برای بهرهمندی از کاربردهای دیپ فیک ایجاد شدهاند. سازمان فضای سایبری چین (Cyberspace Administration of China) اعلام کرده که ایجاد اخبار ساختگی با استفاده از دیپ فیک غیرقانونی است.

در آمریکا هم تقریباً در تمام ایالتها قوانینی برای مقابله با ساخت محتوای مستهجن با استفاده از این فناوری وضع شده است. در ضمن لوایحی برای ممنوعیت انتشار آن دسته از محتواهای ساختگی که انتشار آنها میتواند پیامدهای منفی مختلفی را برای نامزدهای سمتهای دولتی این کشور به همراه داشته باشد نیز مطرح شده است.

کاربردهای دیپ فیک

استفاده از دیپ فیک با انتشار محتوای مستهجن آغاز شد و بسیاری از سلبریتیهای زن قربانی آن شدند. پس از آن سیاستمداران هدف قرار گرفتند و بهعنوانمثال ویدیوهای ساختگی نشاندهنده توهینهای باراک اوباما به دونالد ترامپ منتشر شده است. در ویدیوی ساختگی دیگری دونالد ترامپ در حال تمسخر مقامات مسئول بلژیک برای پیوستن این کشور به توافقنامه اقلیمی پاریس نمایش داده شده است.

البته تمام کاربردهای دیپ فیک به موارد غیرقانونی ختم نمیشود و میتوان بهصورت قانونی و در زمینههای مفید نیز از تواناییهای بالقوه آن بهرهمند شد. در حال حاضر در اپ استور و گوگل پلی استور اپلیکیشنهای زیادی برای تغییر چهره وجود دارند. همچنین شبکه خبری MBN کره جنوبی از فناوری دیپ فیک برای تغییر چهره مجریان خبر خود بهصورت ساختگی استفاده میکند. اکنون اجازه دهید با برخی از کاربردهای غیرقانونی و قانونی دیپ فیک آشنا شویم.

اخاذی

متأسفانه همانطور که گفتیم دیپ فیک بهراحتی میتواند بهعنوان ابزاری برای اخاذی و بدنام کردن، توسط افراد شرور به کار گرفته شود؛ زیرا در حال حاضر هنوز تعداد زیادی از افراد جامعه، بهخصوص افراد مسن، از این فناوری و نحوه کار آن اطلاع ندارند.

سیاست

همانطور که قبلاً گفتیم سیاستمداران مهم جزو متداولترین قربانیان ویدیوهای ساختگی هستند و افراد زیادی تلاش میکنند اعتبار سیاستمداران مهم مثل نامزدهای انتخابات را با ویدیوهای ساختگی زیر سؤال ببرند.

در سال ۲۰۱۹ دو هنرمند رسانهای به نام «فرانچسکا پانتا» (Francesca Panetta) و «هالسی بورگوند» (Halsey Burgund) از دانشگاه MIT ویدیویی جعلی ساختند که در آن «ریچارد نیکسون»، رئیسجمهور اسبق آمریکا در آن نمایش داده شده بود. ریچارد نیکسون در آن ویدیو اعلام کرد که مأموریت فضاپیمای آپولو ۱۱ شکست خورده و هیچ یک از خدمه آن از کره ماه برنگشتهاند. در این ویدیو از یک سخنرانی واقعی استفاده شده بود و اعضای تیم سازندهاش شش ماه برای ساخت آن وقت گذاشته بودند. در ضمن این گروه پژوهشی در وبسایت خود یک سری محتوای آموزشی بارگذاری کردند که به نحوه کار فناوری دیپ فیک و همچنین نحوه تشخیص محتوای ساختگی و جعلی از محتوای واقعی کمک میکرد.

هنر

در حوزه هنر از دیپ فیک برای جان بخشیدن به تصاویر پرتره و صحبت کردن آنها استفاده میشود. پژوهشگران روسی برای به صحبت درآوردن مونالیزای داوینچی از این فناوری استفاده کردهاند. در موزه هنری «سالوادور دالی» (The Dali Museum) در فلوریدا نیز با این فناوری، تصویر این هنرمند را به صحبت درآوردهاند و تصویر این هنرمند با بازدیدکنندگان موزه صحبت میکند. چنین ایده جالبی برای جذب افراد اجرا شده است.

بازیگری

در ساخت فیلمهای سینمایی پرهزینه فانتزی و علمی و تخیلی از این فناوری برای ایجاد تغییرات در چهره بازیگران یا جایگزینی کامل چهره آنها استفاده میشود. بهعنوانمثال «در فیلم جنگ ستارگان: یک سرکش» (Rogue One: A Star Wars Story)، دیپ فیک برای بازسازی کامل چهره دو شخصیت این فیلم یعنی پرنسس لیا (Princess Leia) و گرند ماف تارکین (Grand Moff Tarkin) استفاده شده است.

ساخت فیلم

استودیوهای فیلمسازی دیزنی در حال کار روی جلوههای بصری دیپ فیک مختص خود هستند تا هم هزینه و هم زمان لازم برای ایجاد شخصیتهای موردنظر تا جای ممکن کاهش پیدا کند؛ البته این جلوههای بصری در حال حاضر چندان کارآمد نیستند؛ زیرا اجرای آنها با کیفیت بالا تنها در رزولوشن پایین امکانپذیر و پیادهسازی آنها در رزولوشنهای بالاتر نیازمند تلاش بیشتری است. این جلوههای بصری برای ساخت فیلم جنگ ستارگان: یک سرکش نیز مورد استفاده قرار گرفتهاند.

شبکههای اجتماعی

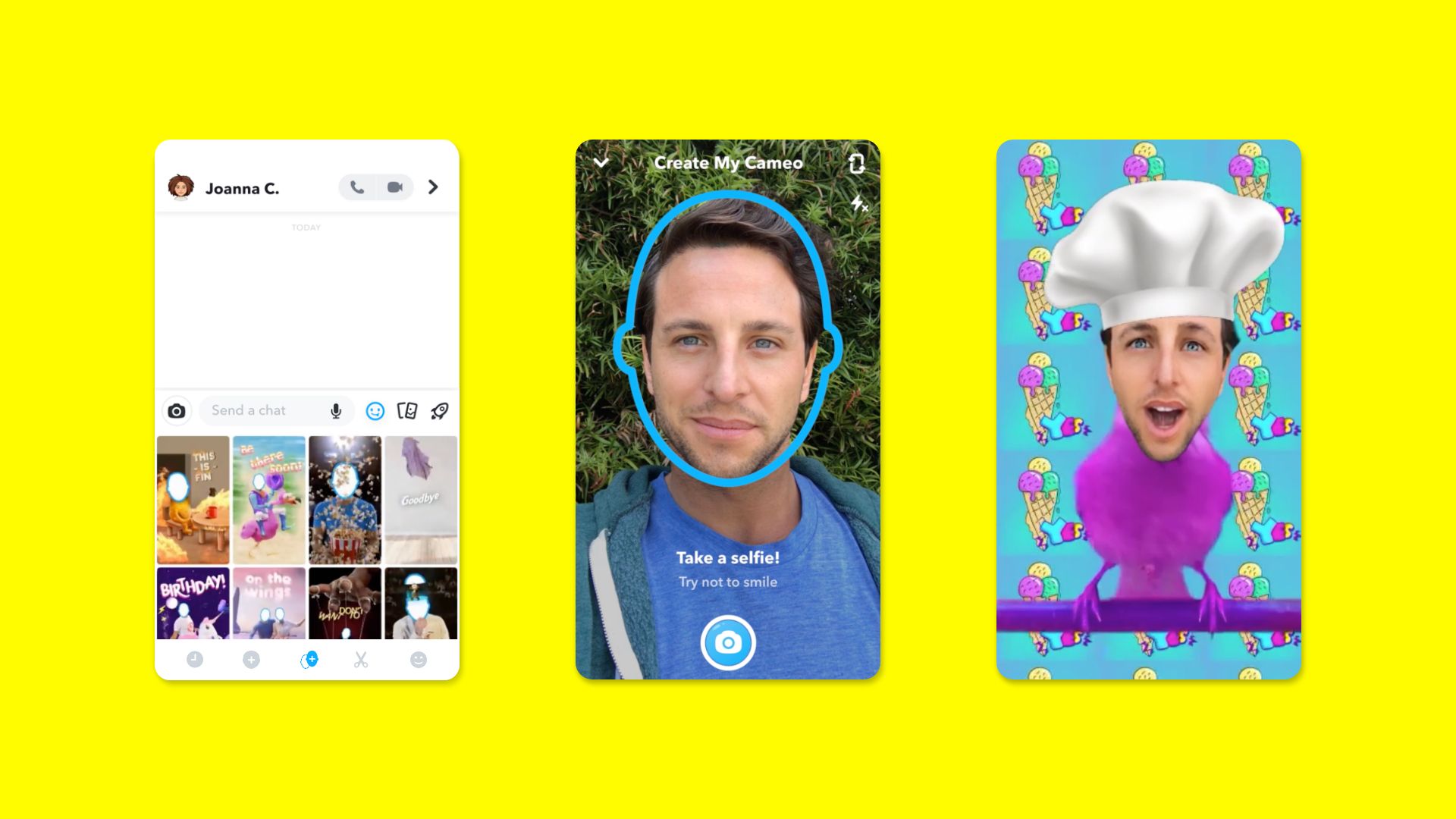

اگرچه سیاستها و خطمشیهای جدید بسیاری از شبکههای اجتماعی مانند فیسبوک و توییتر، بر پایه مقابله با فناوری دیپ فیک و ممنوعیت محتوای ساختگی ایجاد شدهاند؛ اما چنین محتواهایی هنوز هم در میان محتوای منتشر شده در برخی شبکههای اجتماعی دیده میشود. اسنپ چت استفاده از قابلیت تغییر چهره در اپلیکیشن دوربین خود را از سال ۲۰۱۶ امکانپذیر کرده است. تیکتاک هم تکنیک جدیدی ابداع کرده که کاربران با استفاده از آن میتوانند صورت خود را در ویدیوها تغییر دهند.

دیپ فیک در اسنپ چت

سوءاستفاده از هویت ساختگی

همانطور که قبلاً گفتیم یکی از شبکههای خبری کره جنوبی برای تغییر چهره مجریان خود از فناوری دیپ فیک استفاده میکند و در حقیقت با این کار شخصیتهای کاملاً متفاوتی را جایگزین آنها میکند. یکی از شخصیتهای جایگزین مجری، عدهای را به همدردی با افراد تروریست متهم کرد و سرانجام مشخص نشد چه کسی در پشت آن چهره ساختگی چنین اتهامی را به افراد موردنظر وارد کرده است.

در سال ۲۰۱۷ عدهای از پژوهشگران و کارآفرینان، نرمافزاری به نام Synthesia را با قابلیت ایجاد محتوای بصری و صوتی جعلی با قابلیتهای هوش مصنوعی تهیه کردند که به کاربرانش اجازه میداد ویدیوهای واقعی با شخصیتهای تخیلی ایجاد کنند.

نحوه تشخیص محتوای دیپ فیک

همانطور که هوش مصنوعی باعث پیدایش فناوری دیپ فیک شده؛ فناوریهای قابلاستفاده برای تشخیص محتوای دیپ فیک نیز بر پایه الگوریتمهای هوش مصنوعی ایجاد شدهاند که مشابه الگوریتمهای مورد استفاده برای ساخت خود محتوای دیپ فیک هستند. این الگوریتمها میتوانند نشانههایی را که در عکسها و ویدیوهای واقعی وجود ندارند، تشخیص دهند.

مقایسه محتوای واقعی با محتوای دیپ فیک

در ابتدا این الگوریتمها تنها میتوانستند با تشخیص غیرمعمول بودن پلکزدن افراد در ویدیوهای ساختگی یا پلکنزدن آنها، ساختگی بودن ویدیوها را تشخیص دهند و درصورتیکه پلکزدن افراد هم در ویدیوها شبیهسازی میشد، این الگوریتمها فریب میخوردند؛ اما بعدها توانایی درک آنها بهبود یافت و توانستند پلکزدنهای ساختگی را نیز تشخیص دهند: از دیگر نشانههای محتوای ساختگی میتوان به موارد زیر اشاره کرد:

رنگ پوست غیرواقعی یا تغییر رنگ صورت

حرکات غیرطبیعی

هماهنگ نبودن سخنان در حال بیان توسط افراد با حرکات لبهای آنها یا هماهنگی ضعیف بین آنها

تارتر بودن چهره و حالت بدنی افراد نسبت به پسزمینه محتوا

نوردهی غیرطبیعی محتوا یا سایر مشکلات مرتبط با این زمینه

پیکسلهای اضافی در هر فریم

نحوه مقابله با دیپ فیک

چند شرکت فناوری مطرح و پیشتاز در حال کار کردن روی روشهای اختصاصی خود برای مقابله با محتواهای ساختگی هستند، مایکروسافت و گوگل در حال تهیه کردن مجموعه دادههایی هستند که توسعهدهندگان با استفاده از آنها میتوانند سیستمهای خود را برای تشخیص محتوای دیپ فیک آموزش دهند.

فیسبوک نیز مدتی پیش برای اعلام طرح چالش تشخیص دیپ فیک (Deepfake Detection Challenge) بهمنظور توسعه روشهای تشخیص ویدیوهای ساختگی، مشارکت خود را با مایکروسافت، سرویسهای وب آمازون و دانشگاههای مطرح و پیشتاز سراسر جهان آغاز کرد. این طرح در قالب یک مسابقه برای دستیابی به بهترین روش یا روشها برای تشخیص ویدیوی ساختگی اجرا شد و جایزه فرد برنده ۵۰۰ هزار دلار بود. روشهای نرمافزاری برای دستیابی به چنین هدفی که تقریباً ۳۵۰۰ شرکتکننده را درگیر خود کرده بودند، متنباز بودند و به همین دلیل سایر پژوهشگران هم بهراحتی میتوانستند از آنها استفاده کنند.

آژانس پروژههای پژوهشی پیشرفته دفاعی (DARPA) یا دارپا که یک سازمان دولتی متعلق به وزارت دفاع ایالاتمتحده است، پروژهای تحت عنوان MediFort را ایجاد کرده که بر اساس آن، دارپا و سازمان پژوهشی اسآرآی اینترنشنال (SRI International) آمریکا، توافقی را برای ایجاد روشهای تشخیص عکسها و ویدیوهای دستکاریشده امضا کردند.

شرکت Sensity نیز راهحلهای خود را برای شرکتهایی که میخواهند از خود در برابر پیامدهای منفی سوءاستفاده از محتوای دیپ فیک، محافظت کنند، ارائه کرده است. Operation Minerva نیز یکی دیگر از ابزارهای تشخیص محتوای ساختگی محسوب میشود که سیستمی برای تشخیص محتوای مستهجن ساختگی و حذف آن است.

ویژگیهای زیستسنجشی به مقابله با دیپ فیک کمک میکنند؟

ویژگیهای زیستسنجشی مثل اثرانگشت و عنبیه چشم که برای هر انسان بهصورت اختصاصی خلق شدهاند و یکسان نیستند، یکی از بهترین راههای تشخیص هویت افراد هستند. این ویژگیها میتوانند برای تشخیص محتوای ساختگی نیز مفید واقع شوند. تشخیص چهره با استفاده از هوش مصنوعی نیز میتواند ابزار بسیار مفیدی برای تشخیص چنین محتواهایی باشد.

آینده دیپ فیک

دیپ فیک هنوز فناوری نوپایی محسوب میشود و وعدههای بسیار زیادی در مورد آن داده شده است. اکثر افراد جامعه نیز هنوز اطلاعات زیادی در مورد این فناوری ندارند و تواناییهای بالقوه آن هم هنوز بهصورت کامل کشف نشده است؛ اما قطعا هنوز تا فهم کامل تأثیرات مثبت و منفی این فناوری در حوزههای مختلف، زمان زیادی باقی مانده و در آینده روشهای بیشتری برای مقابله با سوءاستفادههای غیرقانونی از این فناوری و کنترل بیشتر آن ایجاد خواهد شد.

طبیعتا این فناوری نوظهور نیز مانند سایر فناوریها مزایا و معایب خود را دارد. این فناوری از یک سو میتواند به چهرههای برجسته و شاخص آسیبهای غیراخلاقی، معنوی و روحی جبرانناپذیری وارد کند، اما از سوی دیگر میتواند در حوزه ایجاد پرترههای دیجیتال، فیلمسازی، انیمیشنسازی و سایر حوزههای مشابه بهعنوان ابزاری مفید استفاده شود.

سؤالات متداول درباره دیپ فیک

دیپ فیک چگونه ایجاد میشود؟

دیپ فیک با فناوریهای مبتنی هوش مصنوعی ایجاد میشود که چهره افراد با چهره ساختگی جایگزین میشود.

مبدع دیپ فیک چه کسی بوده است؟

این فناوری توسط یک شخص خاص ایجاد نشده، بلکه ابتدا توسط پژوهشگران مؤسسات آموزشی فناوری ایجاد شده و سپس در دسترس عموم مردم قرار گرفته است.

چگونه میتوانیم دیپ فیک را تشخیص دهیم؟

برخی از محتواهای دیپ فیک غیرحرفهای ساخته شدهاند و تشخیص آنها ساده است؛ اما در برخی موارد تشخیص این محتواها بدون استفاده از نرمافزار دشوار است و میتوانید از نرمافزارهای دربردارنده الگوریتمهای هوش مصنوعی استفاده کنید. چنین نرمافزارهایی برای تشخیص خطاها و بیدقتیهای ایجاد شده در هنگام ساخت محتواهای بصری ساختگی تهیه شدهاند.

اصلیترین الگوریتمهای هوش مصنوعی برای ایجاد محتوای دیپ فیک چیست؟

دیپ فیک یک فناوری ایجاد شده بر پایه الگوریتمهای یادگیری عمیق هوش مصنوعی است. روش شبکههای عصبی خودرمزگذار و شبکههای زایای دشمن گونه، دو روش مهم و اصلی برای ساخت چنین محتوایی هستند.

در حال حاضر چه تعداد محتوای دیپ فیک ایجاد شده است؟

هیچ کس در مورد این موضوع مطمئن نیست؛ اما طبق گزارش منتشر شده از سوی CNN در اکتبر ۲۰۱۹ حداقل ۱۴۶۸۷ ویدیوی آنلاین دیپ فیک در فضای مجازی قرار داشت.

منبع: RecFaces

ترجمه: دیجیاتو